目前国际上最常用的骨盆性别推断方法是PHENICE[5]在1969年提出的腹侧弧、耻骨下凹、坐骨耻骨支内侧缘(medial aspect of the ischiopubic ramus,MIPR)三联征的形态学观察法。随后的验证性研究在一定程度上证实了此方法的可行性,但是相当一部分研究并没有获得相对较高的准确率[6-11],这是因为形态学观察法具有高度个体主观性,依赖于观察者的既往人类学经验与主观判断。此外,不同种族人群间的差异性会影响性别推断的准确率和精准度。因此,基于欧美人群骨骼特征建立的性别推断标准可能难以适用于我国当代汉族人群[12-14]。目前,有学者[15]针对我国不同地区的人群通过测量骨盆特殊区域的计量学数据构建判别函数进行性别推断。但此种方法操作繁琐、耗费时间,且易受到解剖学标志点缺失的影响。在法医学现场发现的骨骼遗骸常有部分遗失,很多情况下发掘的骨盆遗骸不完整。因此,建立更符合我国当代汉族人群骨骼遗骸形态特征、更为客观稳定且简易的性别推断方法具有实际意义。

随着大数据、互联网和信息科技的发展,人工智能日益受到关注。深度学习作为实现人工智能的一种技术手段,在医学领域的疾病诊断中发挥着强大的作用[16-18]。ESTEVA等[19]证明了人工智能方法对皮肤癌图像进行分类的能力,其水平可与熟练的皮肤科医生相媲美。此外,部分法医学者已经开始将深度学习引入法医学的各个领域。SPAMPINATO等[20]首次结合深度学习方法与影像学图像进行骨骼年龄推断,展现出该技术优异的性能。ZHOU等[21]首次证明了利用卷积神经网络(convolutional neural network,CNN)对数字化全景硅藻涂片进行自动识别的可能性,其硅藻识别准确率高达97.7%,且比人类专家更加高效。ZHANG等[22]开发的人工智能系统可进行肺组织硅藻与水样硅藻的自动匹配,其高效性与简易性为尸体溺水地点的准确推断提供了基础。CAO等[23]将深度学习技术与光学三维扫描技术相结合,探究了对法医学现场发现的骨骼遗骸进行即时性别推断的可行性。

本研究利用影像学技术构建MIPR图像数据库,采用Inception v4模型训练和迁移学习算法,对耻骨该特征区域构建深度学习推断模型,以实现成年人骨骼遗骸性别的自动分类。

1 材料与方法

1.1 样本收集

本研究调取了700例2015—2017年西安交通大学附属三二〇一医院的汉族人群骨盆CT影像学资料作为数据集(男性350例,女性350例),剔除与本研究无关的受试者其他相关信息(如家庭住址、电话、诊疗信息等),只保留性别、年龄和种族3项人类学相关个体特征信息。

纳入标准:(1)民族为汉族;(2)体检资料显示籍贯在陕西地区;(3)CT影像清晰,受试者配合良好,无伪影;(4)年龄为20~85岁。

排除标准:(1)骨盆存在发育畸形或有骨病、骨折史;(2)既往有生长发育及骨代谢药物使用史;(3)有体育训练以及其他特殊训练经历。

本研究已获得西安交通大学附属三二〇一医院与司法鉴定科学研究院伦理委员会的批准,并遵照《赫尔辛基宣言》开展相关研究。

1.2 仪器参数

使用Optima CT660(美国GE HealthCare公司)对所有样本进行扫描。扫描参数:管电压120 kV,管电流300 mA,层厚1.25 mm,层间距1 mm,螺距系数0.98。

1.3 方法

1.3.1 图像预处理

(1)将CT影像学资料导入Mimics软件(比利时Materialise公司)进行三维虚拟骨骼重建。CT值限定在226~3 071 HU,将骨骼与周围软组织分离。使用“编辑蒙版”方法将骨盆和周围脊柱与股骨头等骨组织分离。最终获得完整的虚拟骨盆模型。

(2)特征区域图像采集。选择骨盆坐骨与耻骨相连处的MIPR作为研究对象。将MIPR平面与计算机屏幕平行,以确保标准和客观的图像采集程序,然后将这一特征区域的图像从三维虚拟骨骼中裁剪下来,并对获得的图像进行手工标记以建立数据库。本研究分别将骨盆左右两侧的MIPR特征区域进行截图,构建左、右侧数据库。

(3)MIPR图像标准化。将所有图像进行中央裁剪,统一为255像素×255像素,以适配研究采用的Inception v4模型的输入尺寸。

(4)数据扩增。数据扩增是一种广泛使用的有助于提高模型通用性和泛化能力的优化技术,可以有效解决训练样本不足的问题。本研究通过随机改变图像的对比度、亮度和旋转角度(包括90°、180°、270°)等方式增加训练和验证数据集图像的数量,另外引入噪声,避免模型出现过拟合现象。本研究将数据量扩增了3倍。

1.3.2 模型训练

1.3.2.1 Inception v4模型

卷积神经网络是一种深度学习方法,在计算机视觉领域表现出卓越的性能。卷积神经网络模型主要由卷积层和池化层组成,卷积层和池化层的多种组合类似于视皮层腹侧通路中的LGN-V1-V2-V4-IT层次结构[24]。卷积层类似于视皮层简单细胞,负责信息特征的抽象和提取;而池化层则类似于视皮层复杂细胞,对于降低特征信息维度至关重要,从而减轻数据处理的负担。GoogLeNet是CHRISTIAN SZEGEDY在2014年提出的一种全新的卷积神经深度学习框架,其最大的特点就是含有Inception模块[25]。GoogLeNet Inception v4由14个Inception模块以及2种Reduction模块组成,增加了卷积神经网络的宽度和深度,能够更好地提取图像的特征信息。本研究采用GoogLeNet Inception v4网络模型进行训练,并对模型进行细微调整,将最后一层全连接层替换为两分类输出层。

1.3.2.2 迁移学习

本研究收集的700例训练样本较深度学习而言,数据量略少。由于Inception v4超深超宽的模型架构,其完全训练依赖于超大规模的标记图像,而迁移学习是解决数据有限领域训练样本不足的一种非常有效的方式。迁移学习方法是将在大规模样本中预先训练好的网络权重作为新任务的初始参数,而后通过导入新任务图像对网络权重进行微调训练,可以有效提高模型训练的精度和速度。本研究使用的Inception v4架构已在ImageNet数据集上进行了预训练,该数据集包含涉及1 000个类别的1 400万张图像。由于ImageNet数据集所包含的图像种类与骨盆图像有较大差异,因此本研究通过对模型进行初始化学习和迁移学习两种训练方式的比较,评估迁移学习在性别推断领域的可靠性。

1.3.2.3 模型训练策略

通过随机分层抽样方法,从700例成人骨盆CT影像学数据中选取80%(男性280例、女性280例)作为训练验证集,其余20%(男性70例、女性70例)作为测试集。首先,分别将左、右侧MIPR数据库的训练验证集(男性280例、女性280例)分别导入Inception v4模型,并以初始化学习训练模型,再将测试集(男性70例、女性70例)分别导入训练好的模型以评估左、右侧MIPR模型性能是否有差异。之后将左、右侧MIPR数据库的训练验证集(男性560例、女性560例)合并导入Inception v4模型,并以初始化学习训练模型,再将测试集(男性140例、女性140例)导入训练好的模型以评估模型性能。最后,将合并的MIPR数据库的训练验证集(男性560例、女性560例)导入Inception v4模型,并以迁移学习的方式训练模型,而后导入测试集(男性140例、女性140例)以评估模型性能。

训练过程中,使用AdaDelta算法计算模型损失函数以反映模型性能,损失函数将卷积神经网络模型的训练过程提炼成单一指标,称为损失值。模型训练的目的是使其最小化。本研究将初始学习率设置为0.01,批尺寸设置为64,学习率衰减因子设置为0.8,衰减步骤为10。使用导向反向传播(guided backpropagation)算法进行热图分析以明确有助于卷积神经网络模型进行性别推断的像素区域。本研究所有实验均在运行Ubuntu 16.04操作系统的计算机上进行,该计算机配备了NVIDIA TITAN Xp 12GB图形处理单元(graphics processing unit,GPU)、intel i7-8700K中央处理器(central processing unit,CPU)和32GB随机存储器(random access memory,RAM)。

1.3.2.4 模型评价标准

本研究人为地将女性设定为真阳性、男性设定为真阴性,并使用总准确率、女性准确率(即敏感度)、男性准确率(即特异性)、阳性预测值、阴性预测值、受试者操作特征(receiver operator characteristic,ROC)曲线以及曲线下面积(area under the curve,AUC)进行模型的性能评价。

2 结 果

2.1 左、右侧MIPR图像初始化学习模型评价

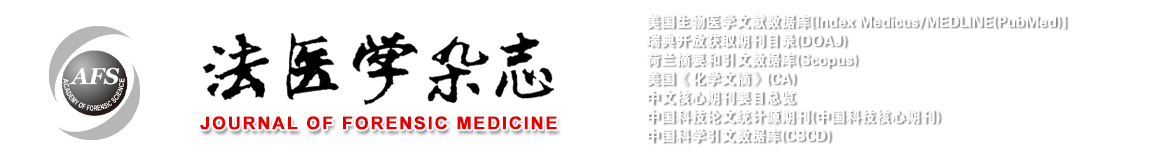

本研究首先将男、女性人群右侧和左侧的MIPR图像分别输入Inception v4模型并以初始化学习的方式直接获取模型在不同层的权重和偏差,分别获得模型1(右侧MIPR初始化学习模型)与模型2(左侧MIPR初始化学习模型)。同时依据准确率和损失函数两个指标在内部验证集上对训练好的模型进行内部评估。如图1所示,模型1与模型2在0~35步有短暂的平台期,而后模型的准确率迅速上升,损失值迅速下降,并在200步左右开始收敛。模型1和模型2在内部验证集中的准确率均达到97%左右,损失函数值在0.1以下。

图1

图1

左、右侧MIPR图像单独初始化学习模型的训练验证及测试性能

A:右侧MIPR模型的准确率;B:右侧MIPR模型的损失函数;C:右侧MIPR模型的ROC曲线;D:右侧MIPR模型的混淆矩阵;E:左侧MIPR模型的准确率;F:左侧MIPR模型的损失函数;G:左侧MIPR模型的ROC曲线;H:左侧MIPR模型的混淆矩阵。

Fig. 1

The performance of the training verification and testing of the initialized learning models of each side of the MIPR images

如图1和表1所示,模型1在测试集(140例)中性别推断的总准确率为95.7%,女性准确率为95.7%,男性准确率为95.7%,阳性预测值为95.7%,阴性预测值为95.7%,AUC值为0.989,男性和女性各仅有3例被错误识别。模型2在测试集(140例)中的总准确率为92.1%,女性准确率为88.6%,男性准确率为95.7%,阳性预测值为95.4%,阴性预测值为89.3%,AUC值为0.967,女性有8例被错误识别。模型1和模型2的平均总准确率为93.9%,女性平均准确率为92.2%,男性平均准确率为95.7%。虽然Inception v4模型在右侧MIPR上获得较好的推断性能,但是左侧MIPR模型具有非常明显的男女间性别推断偏差,模型2的男女性间推断准确率差值达到了7.1%,阳性与阴性预测值差值达到了6.1%。总体上,模型2较模型1总准确率低3.6%,女性准确率低7.1%。

表1 深度学习模型测试集的性别推断性能

Tab. 1

| 模型 | 总准确率/ % | 女性准确率/ % | 男性准确率/ % | 阳性预测值/ % | 阴性预测值/ % | AUC值 |

|---|---|---|---|---|---|---|

| 模型1(右侧MIPR初始化学习模型) | 95.7 | 95.7 | 95.7 | 95.7 | 95.7 | 0.989 |

| 模型2(左侧MIPR初始化学习模型) | 92.1 | 88.6 | 95.7 | 95.4 | 89.3 | 0.967 |

| 模型3(双侧MIPR初始化学习模型) | 94.6 | 92.1 | 97.1 | 97.0 | 92.5 | 0.983 |

| 模型4(双侧MIPR迁移学习模型) | 95.7 | 95.7 | 95.7 | 95.7 | 95.7 | 0.975 |

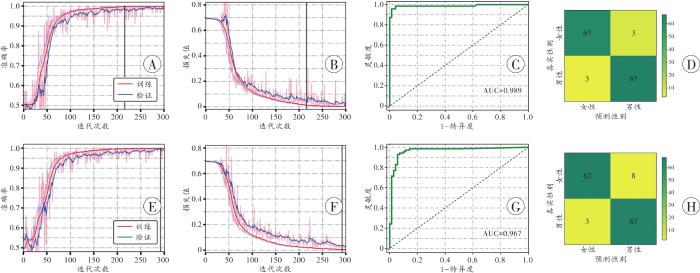

2.2 双侧MIPR图像初始化学习模型评价

为提高模型准确率、消除男女间性别推断偏差、降低左右两侧骨骼间性别推断偏差,本研究将左右两侧MIPR图像合并后统一导入Inception v4模型,以初始化学习的方式进行训练,得到模型3(双侧MIPR初始化学习模型)。如图2所示,模型3在0~35步有短暂的平台期,而后模型的准确率迅速上升,损失值迅速下降,并在200步左右开始收敛。模型3在内部验证集中的准确率达到99%左右,损失函数值在0.05以下。

图2

图2

双侧MIPR图像初始化学习模型的训练验证及测试性能

A:双侧MIPR模型的准确率;B:双侧MIPR模型的损失函数;C:双侧MIPR模型的ROC曲线;D:双侧MIPR模型的混淆矩阵。

Fig. 2

The performance of the training verification and testing of the initialized learning model trained with both sides of the MIPR images

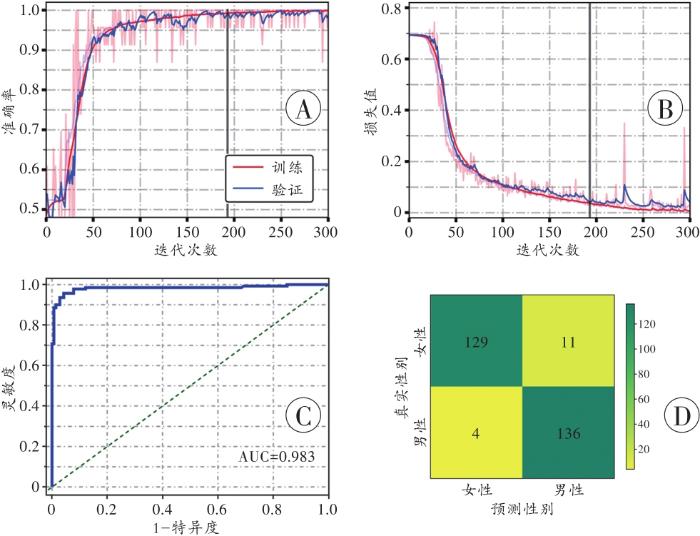

2.3 双侧MIPR图像迁移学习模型评价

本研究将左右两侧MIPR图像合并后统一导入Inception v4模型中,以迁移学习的方式进行训练,得到模型4(双侧MIPR迁移学习模型)。如图3所示,模型4未经历平台期,准确率和损失值在训练伊始就迅速变化,在80步左右开始收敛,并在第229步时获得最佳模型。模型4在内部验证集中的准确率达到99%左右,损失函数值在0.1左右。

图3

图3

双侧MIPR图像迁移学习模型的训练验证及测试性能

A:双侧MIPR模型的准确率;B:双侧MIPR模型的损失函数;C:双侧MIPR模型的ROC曲线;D:双侧MIPR模型的混淆矩阵。

Fig. 3

The performance of the training verification and testing of the transfer learning model trained with both sides of the MIPR images

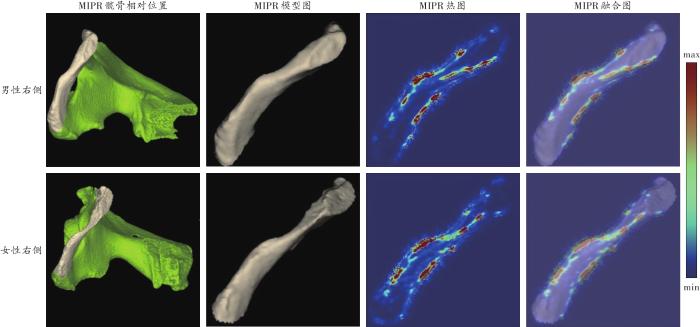

图4

图4

MIPR深度学习模型的热图

红色表示对模型进行性别推断有较大贡献的区域,蓝色表示无贡献的区域。

Fig. 4

Heatmaps of the deep learning models of the MIPR

3 讨 论

在法医学实践中,现有的骨骼遗骸的性别推断方法主要基于骨盆的形态学和计量学特征。计量学方法依赖于大量的样本进行数学函数的修正,但是大多数情况下,收集足够数量的人体骨骼样本并不容易。此外,计量学方法还受到其他固有缺陷的影响,如骨骼标志点难以定位和描述,对多个计量值的测量需耗费大量时间,对骨骼如髋骨的完整性要求极高[7,29-30]。相比之下,形态学方法由于其快速性和简易性而被广泛使用,然而这些方法极易受到个人主观因素的影响,法医的人类学经验丰富程度对性别推断的准确性影响较大,推断结果的一致性较差。因此,探索其他简便快捷并且更为客观的性别推断方法就显得异常重要。海量的数字化数据、计算机强大的计算能力以及先进的算法都使得深度学习技术在复杂的视觉识别任务中取得了显著成果,其在特定视觉识别任务上能够媲美甚至超越人类专家。在深度学习的众多模型中,卷积神经网络被计算机视觉领域广泛采用,其主要由卷积层和池化层组成,前者主要用于从原始图像中学习抽提出来的特征图,后者则将语义相似的特征合并为一个特征。与传统的机器学习方法相比,卷积神经网络有更复杂、更深的网络框架,可以充分利用像素信息的优势。更为重要的是,卷积神经网络模型的性能可以随着训练样本的增加而得到显著改善[31-35]。因此,本研究使用Inception v4卷积神经网络模型来探究使用骨盆中的特殊区域MIPR进行性别推断的可行性。

由于骨骼具有对称性,大部分进行性别推断的研究会在缺少一侧骨骼时采用另一侧骨骼作为代替。但左右两侧骨骼发育并不完全相同,其形态学特征可能略有差异。在法医学现场发现的骨骼常常是不完整的,将一侧骨骼构建的性别推断方法直接用于另一侧骨骼可能会存在一定误差。因此,本研究首先将左右两侧MIPR图像分别导入构建好的卷积神经网络Inception v4,并使用初始化学习的方式对模型进行训练。完全训练的右侧MIPR模型获得了较好的性别推断效果,其总准确率高于左侧MIPR模型。左侧MIPR模型具有较高的男女间性别推断偏差,对于女性性别推断的准确率低于男性。之后将左右两侧MIPR图像合并导入Inception v4模型以初始化学习的方式进行训练,结果显示,深度学习模型针对两侧骨骼间的性别推断偏差被消除,这可能是因为同时输入两侧骨骼图像后,模型内部参数进行了调整与优化,但是模型3(双侧MIPR初始化学习模型)与模型2(左侧MIPR初始化学习模型)一样存在较高的男女间性别推断偏差。这一结果与KLALES等[7]在2012年采用PHENICE非计量特征对髋骨进行性别推断的结果一致。KLALES等采用5分法对左侧髋骨MIPR图像进行观察,其性别推断准确率仅为75.8%,男性准确率为79.3%,女性准确率为72.3%,男女性之间存在较高的性别推断偏差。本研究使用迁移学习对合并后的左右两侧MIPR图像进行训练,男女间性别推断偏差得到有效消解,模型4(双侧MIPR迁移学习模型)进行性别推断的总准确率达到了95.7%,针对模型4进行的热图分析结果也显示模型是基于MIPR的特定解剖学结构进行的性别推断。本研究与其他利用MIPR进行性别推断的研究相比,准确率更高。事实上,大部分研究的性别推断准确率仅在73.1%~87.3%[6-9]。笔者仅发现一项使用MIPR进行性别推断的研究获得了96.1%的准确率,但其男女间性别推断偏差达到8.2%[10]。

深度学习技术以矩阵的方式直接处理二维图像,卷积神经网络通过卷积层直接获取骨骼图像的性别特征从而进行最优分类,避免了传统形态学性别推断方法主观性强、经验依赖性的局限性,摆脱了计量学方法人工测量的复杂性和耗时性。尽管基于深度学习的性别推断方法具有较高的性能,但本研究仍有一定的局限性。首先,本研究中使用的数据集相对较小,虽然通过数据扩增以及左右两侧骨骼图像合并训练的方式增加了图像数量,同时使用迁移学习方法提高了模型性别推断的准确率,但很多探究迁移学习可行性的研究[34-38]都表明使用迁移学习方式训练的模型性能低于在超大数据集上以初始化学习方式训练的模型性能,因此,需要增加骨骼图像数据集数量,从而进一步提高模型性别推断的准确率。其次,本研究收集的样本来自同一个平台,因此需要进一步评估模型在不同仪器、软件及人群中的适用性和泛化能力。

本研究证明了深度学习技术在性别推断领域的潜力,通过迁移学习训练左右两侧MIPR图像构建的Inception v4模型获得了95.7%的准确率和更小的男女间性别推断偏差以及更小的左右两侧骨骼间性别推断偏差,相信在不久的将来,深度学习技术会成为更准确的性别识别的强有力补充工具。

参考文献

Efficient 3D dental identification via signed feature histogram and learning keypoint detection

[J].

3D-2D silhouette-based image registration for comparative radiography-based forensic identification

[J].

Forensic human identification in the United States and Canada: A review of the law, admissible techniques, and the legal implications of their application in forensic cases

[J].

2012

.

Functional aspects of pelvic morphology in Simian Primates

[J].

A newly developed visual method of sexing the os pubis

[J].

Phenice’s visual sexing technique for the os pubis: A critique

[J].

A revised method of sexing the human innominate using Phenice’s nonmetric traits and statistical methods

[J].

22102

.

Improving nonmetric sex classification for hispanic individuals

[J].

Morphoscopic observations in clinical pelvic MDCT scans: Assessing the accuracy of the Phenice traits for sex estimation in a Western Australian population

[J].

2018

.

method of sexing the human innominate for Mexican populations

[J].

Use of the ventral arc in pubic sex determination

[J].

Test of Phenice’s technique for determining sex from the os pubis

[J].

Revisiting the Phenice technique sex classification results reported by MacLaughlin and Bruce (1990)

[J].

morphoscopic pelvic sexing method

[J].

Estimation of stature and sex from sacrum and coccyx measurements by multidetector computed tomography in Chinese

[J].

鼻骨区骨折深度学习模型的建立和临床效能评估

[J].

Establishment and evaluation of the clinical efficacy of deep learning model for detection of nasal bone fracture on CT images

[J].

基于深度学习的结肠癌病理图片分类研究

[J].

Classification for pathological images of colon cancer with deep learning

[J].

深度学习模型检测胸部CT肺结节的临床效能评估

[J].

Evaluation of the efficacy of deep learning model in detecting pulmonary nodules on chest CT images

[J].

Dermatologist-level classification of skin cancer with deep neural networks

[J].

Deep learning for automated skeletal bone age assessment in X-ray images

[J].

Digital whole-slide image analysis for automated diatom test in forensic cases of drowning using a convolutional neural network algorithm

[J].

An efficient method for building a database of diatom populations for drowning site inference using a deep learning algorithm

[J].

A potential method for sex estimation of human skeletons using deep learning and three-dimensional surface scanning

[J].

Deep learning

[J].

Inception-v4, Inception-ResNet and the impact of residual connections on learning

[C]//

基于深度学习实现维吾尔族青少年左手腕关节骨龄自动化评估

[J].

Automated assessment for bone age of left wrist joint in Uyghur teenagers by deep learning

[J].

运用3种卷积神经网络模型对青少年骨盆骨龄评估的比较

[J].

Comparison of three CNN models applied in bone age assessment of pelvic radiographs of adolescents

[J].

Forensic bone age estimation of adolescent pelvis X-rays based on two-stage convolutional neural network

[J].

Sexing of the human innominate using non-metric traits and statistical analysis

[J/OL]. [

Deep learning-based classification of mesothelioma improves prediction of patient outcome

[J].

Development and validation of a deep learning algorithm for detection of diabetic retinopathy in retinal fundus photographs

[J].

Assessment of convolutional neural networks for automated classification of chest radiographs

[J].

Identifying medical diagnoses and treatable diseases by image-based deep learning

[J].

Classification and mutation prediction from non-small cell lung cancer histopathology images using deep learning

[J].

Transfer learning for medical image classification: A literature review

[J].

Transfer learning for small molecule retention predictions

[J].

Deep learning-based transfer learning for classification of skin cancer

[J].